Интеллект — главное, что выделяет человека на фоне всех остальных живых существ, населяющих Землю. Все, чем пользуется сегодня цивилизация, — результаты интеллектуальной деятельности человека или группы людей. Наши знания и умения мы передаем потомкам, помогая им прогрессировать.

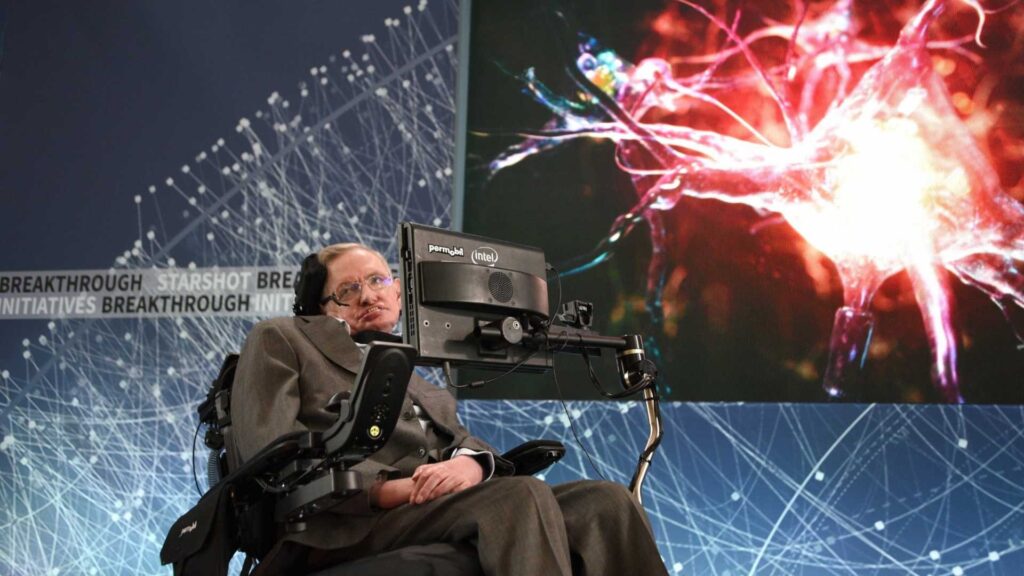

«Триумф, что мы, являясь по сути звездной пылью, смогли осознать Вселенную в которой живем. Однако разумными мы были не всегда и нам пришлось пройти сложный эволюционный путь. Теперь вполне справедливо, что мы умнее своих предшественников, а Эйнштейн был умнее своих родителей», — писал Стивен Хокинг.

Прогресс напрямую связан с усложнением и если компьютеры будут дальше следовать закону Мура, удваивая быстродействие и объем памяти каждые 18 месяцев, то уже до конца столетия машина превзойдет самых умных людей по всем интеллектуальным параметрам. Люди же не способны развиваться так быстро.

«Нас ждет интеллектуальный взрыв, который приведет к появлению машин, превосходящих нас в интеллектуальном смысле больше, чем мы превосходим, допустим, улиток. Если наши цели с искусственным интеллектом (ИИ) будут расходиться, то у нас будут огромные проблемы», — добавил Хокинг.

Работа над ИИ уже давно ведется за пределами секретных лабораторий. Внедрять машины в нашу повседневную жизнь стало экономически выгодно и рационально. Мы сами отворили ящик Пандоры, поселив прогрессирующий ИИ рядом с нами и вручив ему часть наших обязанностей.

«Машины позволяют нам делать потрясающие открытия, но мы увлеклись и забыли о рисках. Военные все чаще внедряют ИИ в атомные оружейные системы. Мы хотим, чтобы ИИ стал «калашниковым» завтрашнего дня и приобретался на черном рынке преступниками и террористами?» — задавал вопрос физик

Мы не можем гарантировать, что ИИ будет использоваться только во благо. Кроме этого, мы не знаем, как ИИ будет вести себя через 2-3 десятилетия и не станет ли его создание величайшей ошибкой человечества. Пока все под контролем, но когда же пора начинать бояться?

«Некоторые говорят, что машину можно просто выключить и угроза минует. Хочу отметить, что угроза со стороны ИИ как раз и будет в тот момент, когда он не позволит нам его отключить», — заключил Хокинг.

Да,это очень опасно-потому, что,когда ты программируешь машину-иногда наступает момент,что машина начинает-из-за свого быстродействия и огромной памяти(терабайты)пытаться как бы программировать в ответ тебя!А об этом предупреждали еще великие фантасты Лем,Айзек Азимов,Рэй Бредбери,Артур Кларк и другие!

+++

А ИИ (или AI ?) уже невозможно «отключить» без разрушения цивилизации. Интернет уже обладает всеми свойствами мозга. Попробуйте отключить ВЕСЬ интернет! Хи-хи-хи